揭秘Coatue:AI时代的投资新风向

文 | Alpha Engineer,作者 | 费斌杰

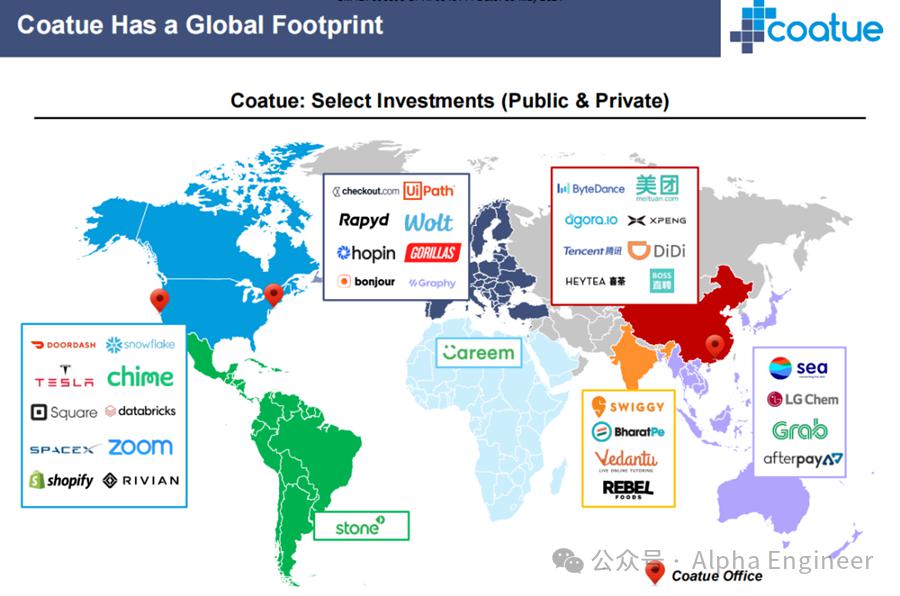

Coatue,这家总部位于纽约的对冲基金向来以低调著称,其官网高冷到只有一个联络邮箱,合伙人也从不接受采访。

但这依然难掩其业绩的锋芒,从 1999 年成立至今,Coatue 的管理规模从 1500 万美金跃升到 486 亿美金。

凭借极强的科技敏锐度和人脉关系网,Coatue 捕捉到了 SpaceX、DoorDash、Zoom、Databricks 等投资机会。

在美国本土攻城略地的同时,Coatue 还敏锐的捕捉到了中国移动互联网的红利,并在腾讯、美团、字节跳动、滴滴等中国超级独角兽上下重注,取得了丰硕的回报。

随着 Web 3 的兴起,这位巨人又切入了加密领域,迅速主导了 NFT 交易平台 OpenSea、支付公司 Silverflow、Web 3 人才网络 Braintrust 以及宝可梦背后 AR 公司 Niantic 等一系列头部企业的融资。

纵观历史,当 Coatue 决定参与游戏时,他瞄准的永远是最大的那条鱼。

如此高冷神秘的 Coatue,近日发布了一份重要报告《Build Index of the Future》,详细剖析了 Coatue 构建 AI 投资组合的方法论,并给出了下一步的配置建议(Edge AI + Power Shortage),具有极高的参考价值。

下面我给大家解读一下这篇大报告。

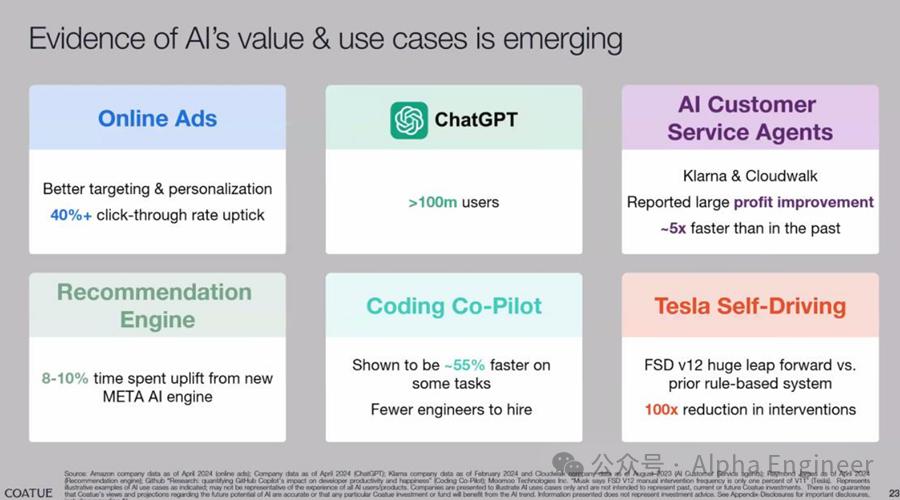

01 AI 的应用价值正在快速涌现

生成式 AI 正在快速从单纯的 Chatbot 变成具备实际经济价值的工具和服务,比如:

- 线上广告:通过 AI 赋能,线上广告能够实现更好的个性化,提升 40% 的点击率。

- 推荐引擎:Meta 更新了 AI 推荐引擎后,用户使用时长提升了 8-10%。

- 编程助手:在部分编程任务中可以提升 55% 的效率,企业主开始减少工程师的雇佣。

- AI 客服:Klarna & Cloudwalk 反馈客服效率提升至少 5 倍,利润显著上升。

- 自动驾驶:特斯拉的 FSD v12 相比上一代性能显著提升,干预度降低 100 倍。

02 算力成本正在指数级下降

以英伟达为例,2017 年英伟达的旗舰显卡是 V100,1 TFLOP 的计算成本是 40 美金。

随着最近 Jensen 在 GTC 大会上正式推出基于 Blackwell 架构的 GB200,1 TFLOP 的计算成本降到了 2 美金,足足下降了 95%。

随着芯片制程、封装工艺的提升,算力成本仍将继续快速下降。

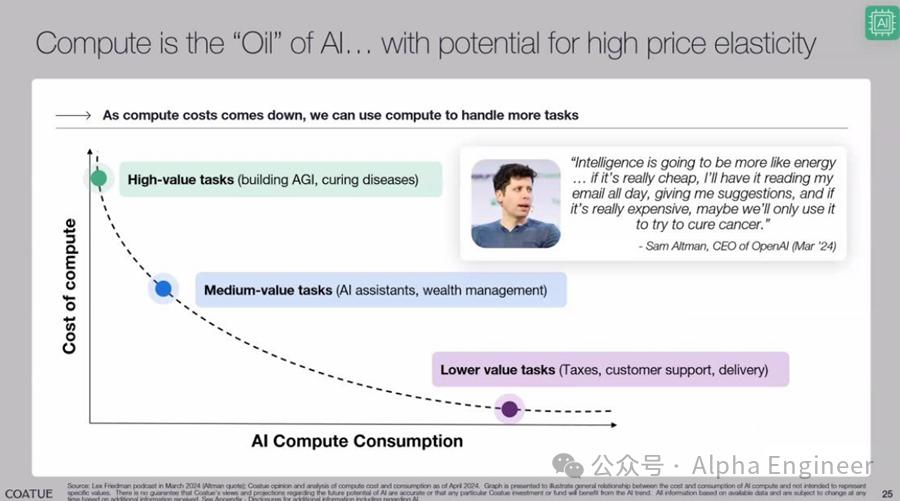

03 " 智能 " 将变得像空气一样无处不在

正如 Sam Altman 所言,如果 " 智能 " 足够便宜,我会让 AI 帮我阅读每一份邮件并给出建议。但如果 " 智能 " 非常昂贵,我们可能只会用 AI 来治疗癌症。

算力成本的下降,将使得 " 智能 " 在未来像空气一样随处可得,嵌入到我们工作生活的每个角落。

KK 最近在交大高金的分享会上提到了一个观点:最好的技术都是 " 隐形 " 的。我们每天都在接触大量科技产物,无论是电灯、风扇、还是手机、导航。我们意识不到这些科技的存在,这恰恰意味着这些技术已经成功了。

未来 AI 也将经历从 " 显形 " 技术逐渐走向 " 隐形 " 的过程,变得无处不在,成为每个人生活中的一部分。

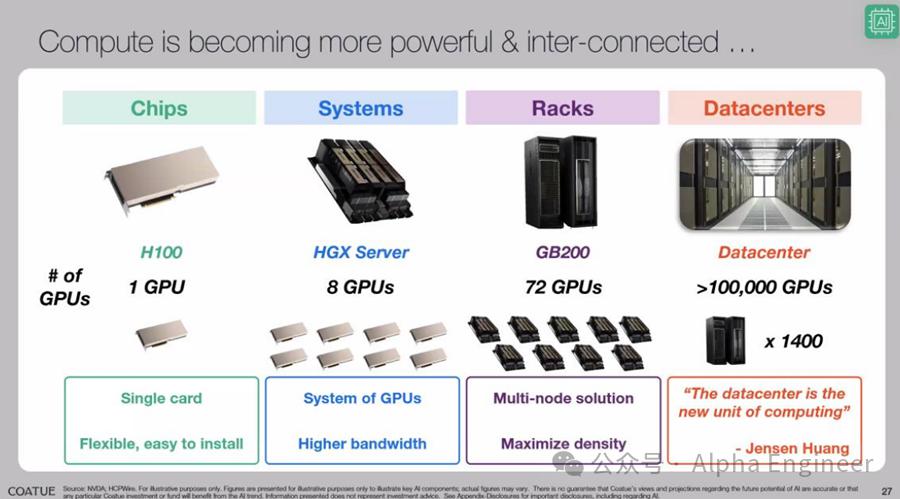

04 AI Infra 的核心主题是 " 互联 "

AI 对算力的需求不断膨胀,而人们已经愈发接近晶体管尺寸的物理极限,要想制造更小芯片的难度与日俱增,摩尔定律走向终结。

但是 Nvidia 敏锐的意识到,纳米尺度的规律同样适用于机柜尺度。通过在机柜中将电缆和逻辑芯片集成得更紧密,也能提升系统的综合性能。

业内将此总结为摩尔定律的数学分形,那些微观尺度适用的规律,在宏观尺度依然生效。

未来我们会将集群的能力压缩进机柜,将机柜的能力压缩进芯片,从系统尺度上延续摩尔定律。

在这个过程中,芯片与芯片之间的互联,集群与集群之间的互联是关键。

正如 Jensen 所言,Datacenter is the new unit of computing。

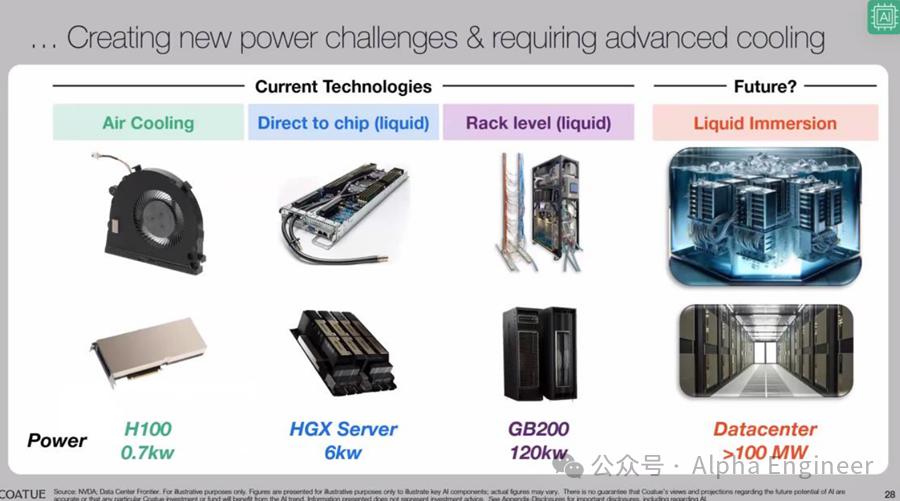

05 先进液冷技术成为刚需

对于单块功耗为 0.7kW 的 H100 卡而言,风冷技术就可以满足散热需求。

但是对于功耗超过 100MW 的数据中心而言,必须采用浸没式液冷技术,才能使其正常运行。

在前段时间召开的 OFC 大会上,Andy Bechtolsheim 明确的给出了液冷技术支持的功率极限。

Andy 认为我们可以在单个机柜中放置 300+ kW 的功率,并且用液冷进行有效冷却。

英伟达最新发布的 GB200 NVL72 的功率是 120kW。也就是说,根据现有液冷技术的水平,机柜功率仍有一倍以上的提升空间。

06 " 星际之门 " 开启超级数据中心军备竞赛

在 AI 时代之前,数据中心的功耗大约 100MW,Microsoft 准备为 OpenAI 建设的 " 星际之门 " 超级数据中心预计将达到 5GW,耗资 1000 亿美金,集成数百万张卡,占地面积超过 10 平方英里。

要知道,23 年全美数据中心加总起来,功耗差不多 7GW。一个 " 星际之门 " 就可以抵得上全美国的算力能耗。

大语言模型 " 暴力出奇迹 " 带来的涌现能力,正在快速转化为新一代超级数据中心建设热潮。

07 能源短缺将成为重要瓶颈,核电是唯一解

根据 Coatue 预测,现有的电力供应体系无法承载 25M 张 GPU 同时运行,电力短缺即将到来。

在巨大的能源缺口下,人们大概率会拥抱核电。

新一代超级数据中心很有可能会建设在核电站周边,形成共生关系,这么做有诸多好处:

- 电力直供,无需经过电网系统

- 核电站边上必然有天然水源,可以作为数据中心液冷用水

- 核电站标配 7 × 24 小时安保,确保数据中心不被人为破坏

- 核电站周边土地资源充沛

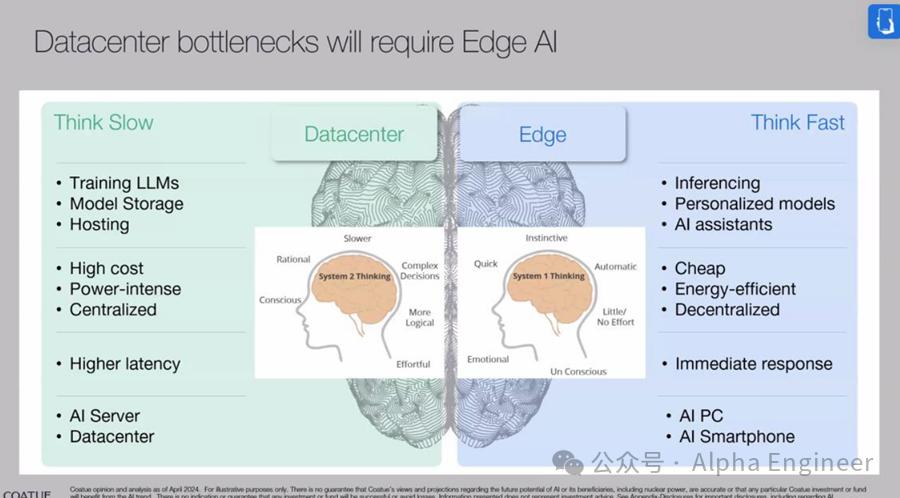

08 Edge AI 以及 AI 换机潮将成为重要投资主线

未来 AI 推理将从中心化逐步转移到边缘侧,形成去中心化的推理网络。

AI 带来的换机潮将成为未来几年的重要投资主线。

边缘 AI 能带来不少好处,首当其冲的就是 " 快 "。

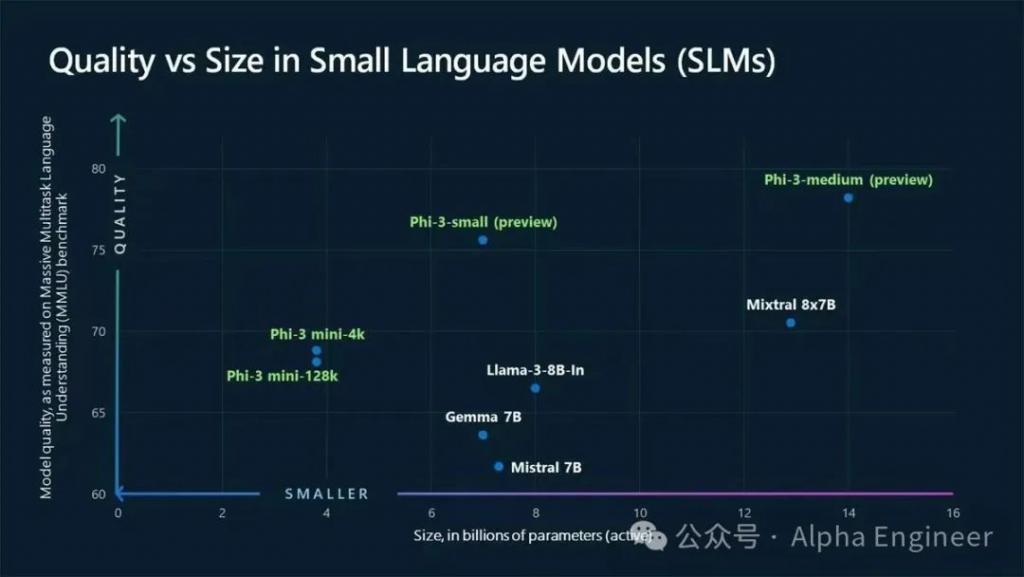

微软的 Orca、Phi 等 SLM 已经初步证明了终端部署大模型的可行性,预计未来 90% 的推理任务会发生在你的手机和 PC 上,对日常工作生活的任务请求进行实时响应。

09 AI Infra 的 TAM 约为 1.2 万亿美金

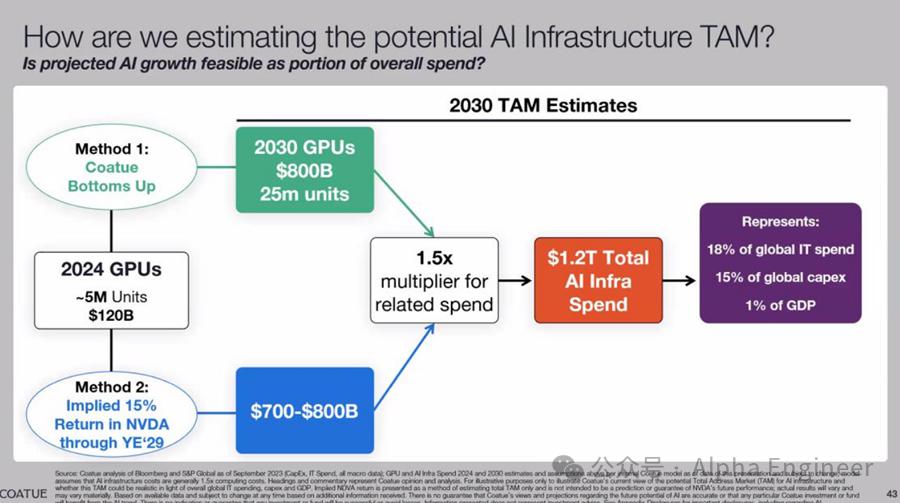

Coatue 采用自下而上和自上而下两种方法,测算了 AI Infra 的市场空间,得出了 1.2 万亿美金的结论。

这个数字大约是全球 IT 支出的 18%,全球 Capex 的 15%,全球 GDP 的 1%。

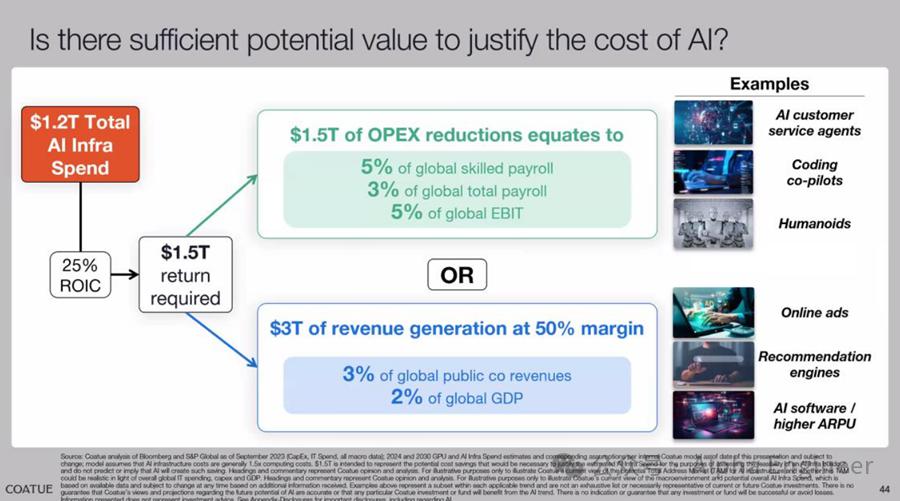

只从供给端出发是不够的,我们还得从需求端验证一下,这么大规模的 AI Infra 投入是否能够产生同等体量的商业价值呢?

按 25% 的 ROIC(投入资本回报率)测算,1.2 万亿美金的 AI Infra 投入需要产生 1.5 万亿美金的回报。

从 " 节流 " 的角度,这可以理解为 1.5 万亿美金的全球 OPEX 削减,这对应着全球总薪资的 3%,全球总 EBIT 的 5%。

从 " 开源 " 的角度,这可以理解为通过 AI 赋能带来 3 万亿美金的增量收入,且毛利在 50%。这对应着全球上市公司总收入的 3%,全球 GDP 的 2%。

10 Coatue 的 AI 投资框架

AI 投资需要重视节奏,Coatue 给出了这个顺序:AI Infra -> Edge AI(硬件) -> AI 应用(软件) -> 具身智能。

目前市场处于 AI Infra 投资的中期,Edge AI 行情的起点。而 AI 应用还处于热身阶段,具身智能距离商业落地尚有距离。

Coatue 很清晰的给出了每个阶段的投资机会,涉及个股,具体可以看原报告,这里重点讲 2 个机会。

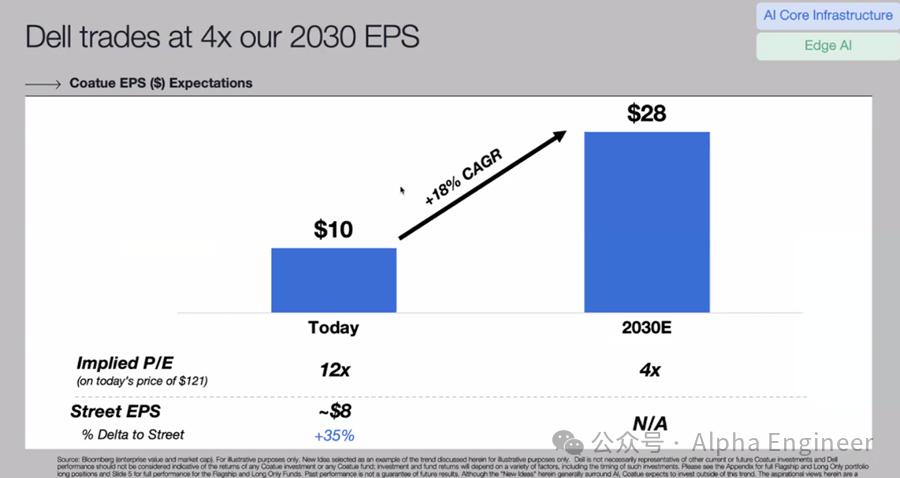

11 Edge AI 对应的重点机会:Dell

Dell 有望成为 Edge AI 浪潮下的最大赢家,其所有业务板块(Storage、PC、Server)都将因此受益。

此外,Dell 新设立的 AI Server 部门目前已经有 30 亿美金的积压订单,处于供不应求的状态。

根据 Coatue 预测,Dell 未来 6 年的业绩 CAGR 约 18%,根据 2030 年 EPS 来看,当前市值对应PE 仅为 4 倍。

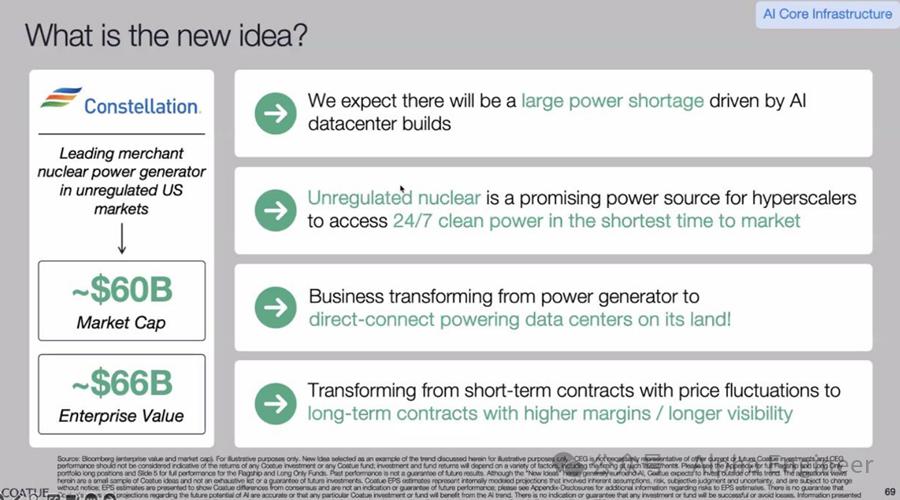

12 Power Shortage 对应的重点机会:Constellation

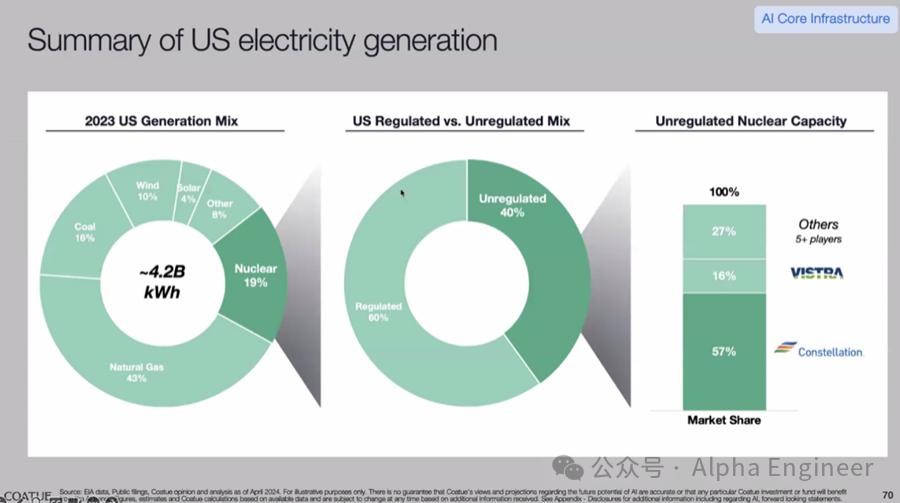

目前美国发电结构中,核电占比 19%,其中稳压与非稳压的占比为 6:4。Contellation 在美国非稳压核电领域的市占率达到 57%,是当之无愧的龙头。

随着电力短缺的带来,非稳压核电将成为率先收益的板块,为超级数据中心 7 × 24 小时提供清洁能源。

Constellation 的定价模式有望从现在的浮动价格短期合同,变成高毛利的长单,增强业绩的可预测性,带来估值的提升。

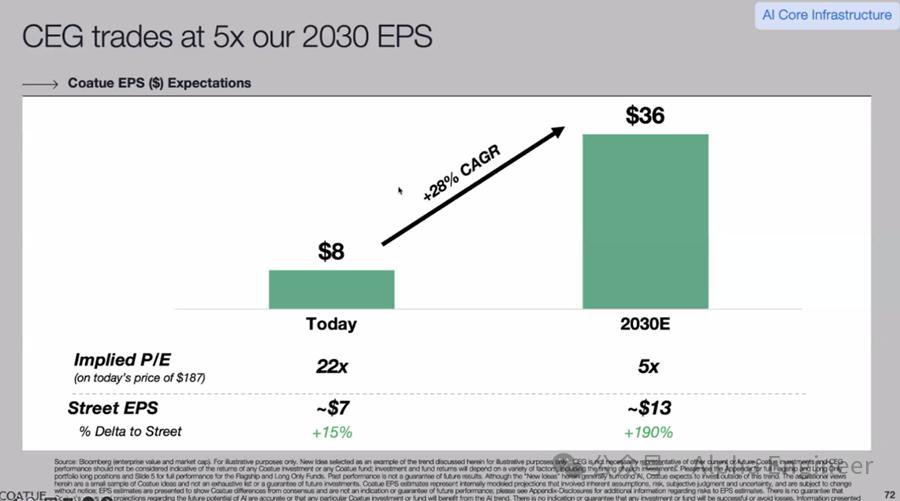

根据 Coatue 的预测,CEG 未来 6 年的业绩 CAGR 约 28%,如果按 2030 年的 EPS 来看,当前市值对应的PE 仅为 5 倍。

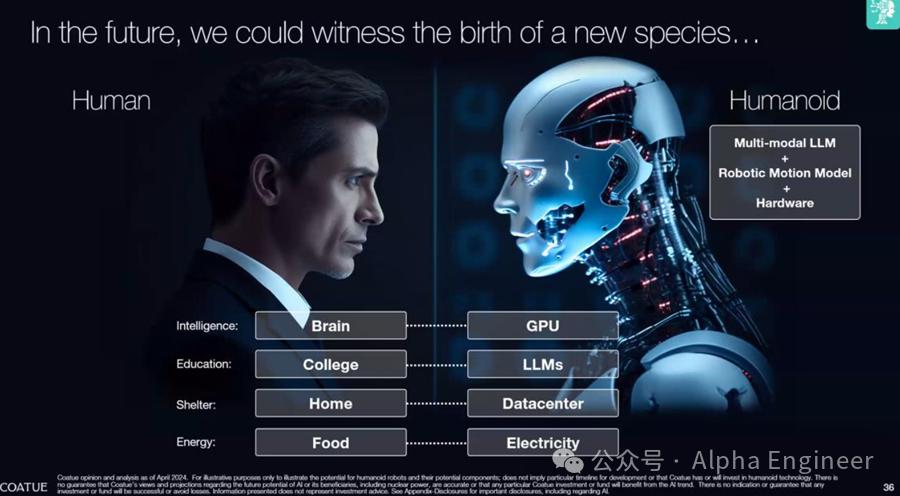

13 在不久的将来,人类将见证一个全新物种的诞生

正如 Sam Altman 所言,过去的 2023 年可能是人类历史上最有趣的一年,但更有可能是未来若干年中最平凡的一年。

随着 AGI 的到来,我们将有幸见证一个全新的硅基物种的诞生。